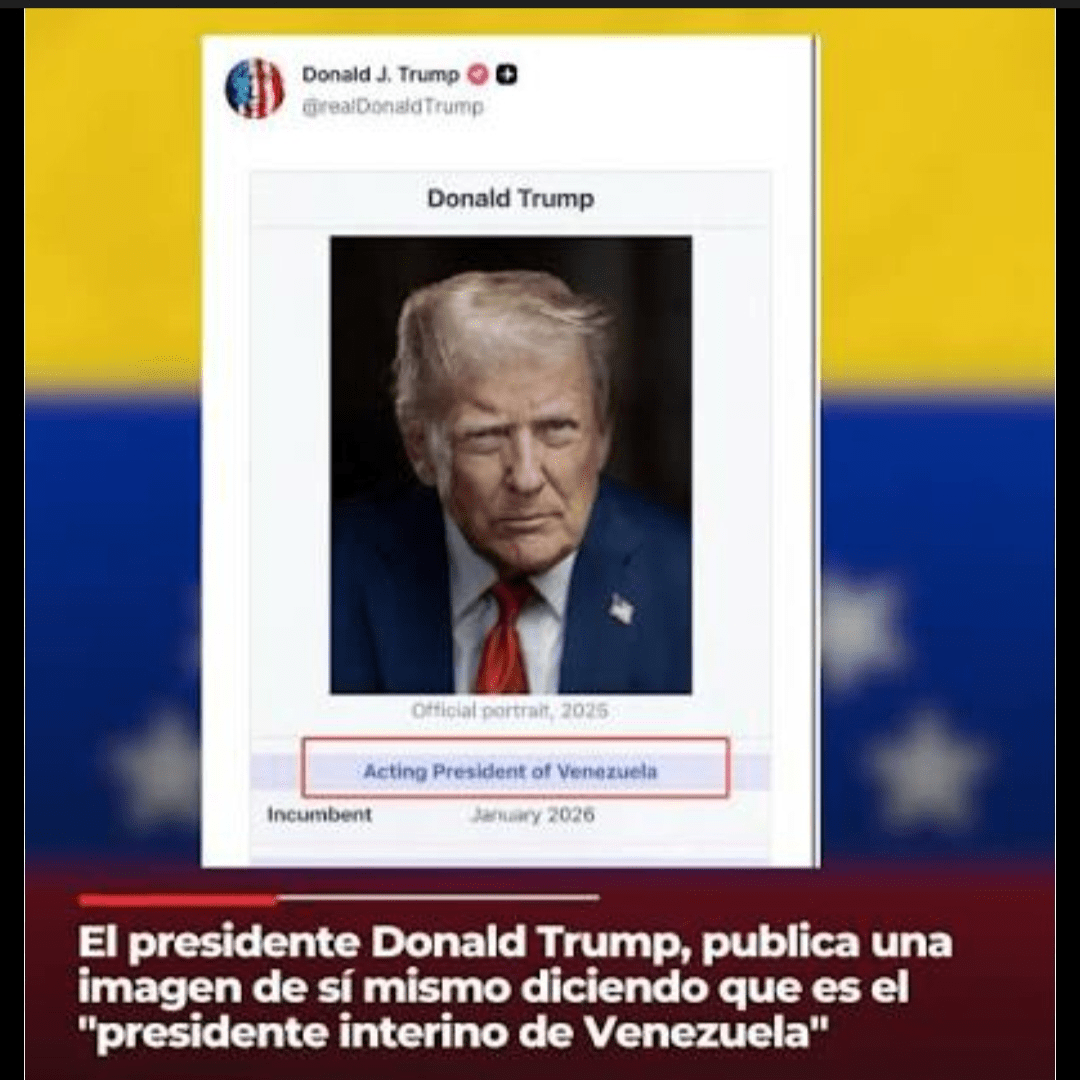

Ces dernières heures, une image virale générée par intelligence artificielle a attiré l'attention internationale : Donald Trump apparaît dans une publication comme « Président par intérim du Venezuela ».

La pièce, manipulée numériquement, s'est rapidement répandue sur les réseaux sociaux et a suscité des débats sur la véracité de l'information et la facilité avec laquelle l'IA peut créer des figures d'autorité fausses. Au-delà de l'impact médiatique, cet épisode reflète un défi croissant : comment distinguer le contenu légitime du contenu fabriqué numériquement ?

La prolifération d'outils d'IA capables de générer des images et des textes extrêmement réalistes pose un dilemme critique pour la politique, les médias et l'opinion publique.

À mesure que la technologie devient plus accessible, la ligne entre le vrai et le faux s'estompe, et la manipulation de l'information peut avoir des répercussions immédiates sur la perception des dirigeants et des décisions politiques.

Dans ce contexte, émergent des protocoles comme Walrus, conçus pour certifier les identités et la crédibilité grâce à des jetons vérifiables. Ces systèmes fondés sur $WAL permettent que l'authenticité d'une publication, d'une déclaration ou d'une image puisse être auditée de manière décentralisée, établissant ainsi un cadre fiable dans un écosystème numérique saturé d'informations.

Les jetons fonctionnent comme des certificats numériques : chaque émission est liée à une identité ou à une institution et ne peut être altérée sans laisser de trace.

Walrus et des technologies similaires se présentent comme une solution à un problème que l'IA accentue : la perte de confiance dans l'information.

Par exemple, un jeton associé à un politicien ou à un média vérifié pourrait alerter les utilisateurs sur un contenu manipulé ou généré artificiellement, en distinguant les faits des simulations numériques.

Cela protège non seulement la réputation des sources, mais contribue également à un environnement numérique plus transparent et plus sûr.

En outre, l'intégration de ces protocoles peut dépasser la vérification des actualités et des personnalités publiques.

Les organisations, les agences de vérification des faits et les médias pourraient utiliser des jetons pour certifier de manière fiable des documents, publications et accréditations, réduisant ainsi le risque de désinformation virale et d'attaques de réputation basées sur l'IA.

Le cas de Trump et de la viralisation de sa déclaration fictive est un exemple clair de la manière dont la manipulation numérique peut influencer la politique et l'opinion publique.

Toutefois, cela montre également une opportunité : des outils comme Walrus offrent un mécanisme tangible pour restaurer la confiance, en combinant la transparence de la technologie blockchain avec la vérification d'identité et la réputation numérique.

Dans un monde où les frontières entre réalité et fiction deviennent de plus en plus floues, la convergence de l'intelligence artificielle et des protocoles de jetons ouvre la porte à un avenir où l'information peut être fiable, auditable et vérifiable.

La question n'est pas si l'IA transformera la politique et la communication, mais si nous disposons des outils appropriés pour garantir que ce que nous voyons et partageons est authentique. De plus en plus difficile à gérer et à maîtriser sur le plan éthique dans ces aspects.