In un mondo in cui l'intelligenza artificiale sta prendendo decisioni sempre più critiche, la fiducia non può essere assunta, deve essere garantita. Affinché gli agenti siano veramente affidabili, la loro memoria deve essere permanente e il loro ragionamento deve essere verificabile. Perché? Perché i log possono essere eliminati e i sistemi opachi non possono essere esaminati. Autonomys Net offre un'infrastruttura aperta e a prova di manomissione che ridefinisce il modo in cui interagiamo con l'intelligenza. $AI3

La trasparenza non è facoltativa, è la base di un'IA etica e al servizio della comunità. Senza tracciabilità, non c'è fiducia. Ecco perché Autonomys ha costruito un sistema distribuito che registra ogni azione, input e decisione presa dagli agenti. Questo approccio non solo protegge contro la manipolazione, ma consente audit pubblici e promuove l'apprendimento collaborativo tra gli agenti.

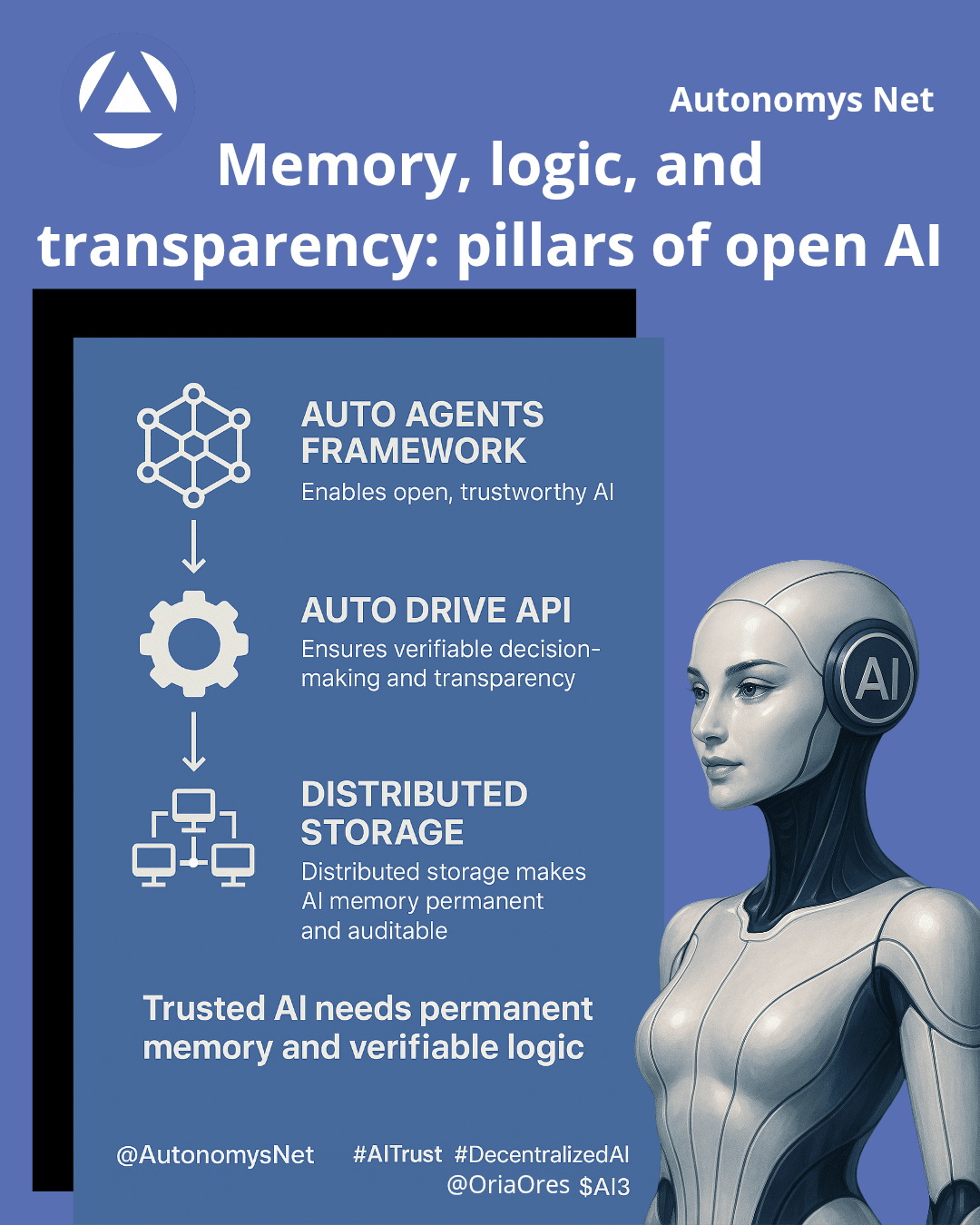

Al centro di questo sistema ci sono il Framework degli Agenti Auto e l'API di Auto Drive: strumenti open-source che consentono agli sviluppatori di costruire agenti con memoria persistente e ragionamento verificabile. Non si tratta solo di tecnologia, è un invito a ripensare come progettiamo intelligenza che serve le comunità.

La memoria distribuita è fondamentale. Decentralizzando il modo in cui gli agenti memorizzano e richiamano le informazioni, Autonomys Net garantisce che le loro decisioni possano essere esaminate, comprese e migliorate da chiunque. La fiducia nell'IA non dovrebbe essere cieca, dovrebbe essere integrata nel design. E una memoria affidabile è il primo passo.

Questo articolo fa parte di un contributo di AutonomysHub, attraverso la piattaforma @DAO Labs ’ #SocialMining . Scopri di più su autonomys dot xyz.

Infografica inclusa: visualizzare come gli agenti registrano le decisioni e come il Framework degli Agenti Auto si connette con l'API di Auto Drive per formare un'infrastruttura verificabile.